Semrush Sensor : de 9,5 à 0,6 Fiasco de mesure ou vrai calme des SERPs ?

Tachons de répondre à la question qui dérange : si le 9,5/10 de février-mars était en partie une illusion construite par Google lui-même, que vaut alors le 0,6/10 d’aujourd’hui ?

Le graphique qui interpelle

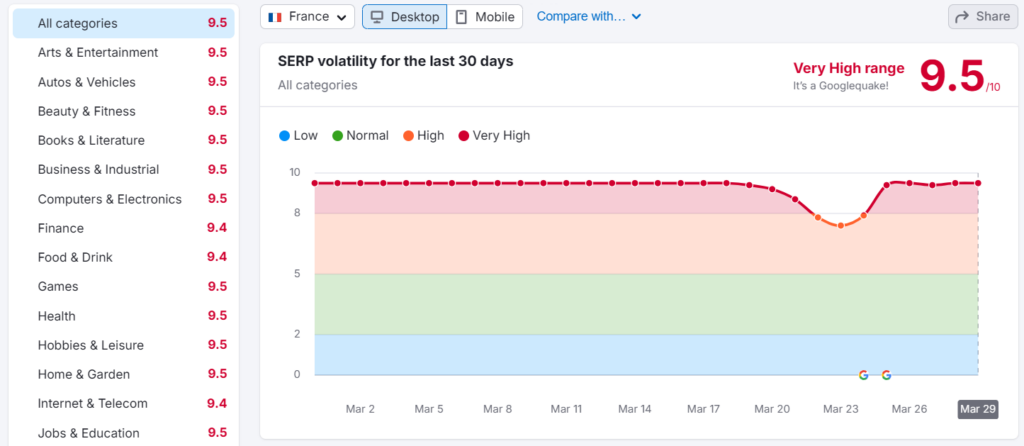

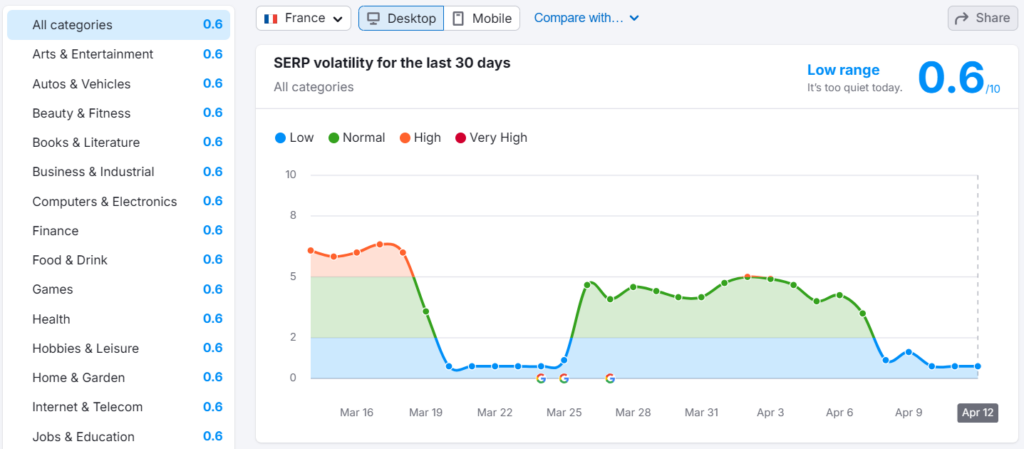

Les deux captures d’écran reproduites dans ce document racontent une histoire difficile à ignorer. D’un côté : 9,5/10 pour la France Desktop fin mars 2026, toutes catégories en rouge vif, le fameux message « It’s a Googlequake ! » affiché partout. De l’autre : 0,6/10 le 12 avril, « It’s too quiet today. »

Moins de deux semaines séparent ces deux extrêmes. Une chute abrupte entamée aux alentours du 19 mars, une remontée lors du déploiement de la Core Update fin mars, puis une plongée vers le plancher à partir du 9 avril.

| Mars 2026 : 9,5/10 | 12 avril 2026 : 0,6/10 | |

| Message affiché | « It’s a Googlequake ! » | « It’s too quiet today. » |

| Couleur dominante | Rouge / Very High | Bleu / Low |

| Interprétation initiale | Séisme algorithmique majeur | Stabilité retrouvée post-update |

| Réalité constatée | Fausse volatilité amplifiée par la soupe | Positions figées + correction anti-bots |

La vraie question n’est pas « pourquoi le Sensor est si bas aujourd’hui ? » mais plutôt : « Est ce qu’un de ces deux mesures est fiable ? »

Acte I : Le 9,5/10 : un « Googlequake » en partie fantôme

La « Soupe Google » ou Shadow SERPs

C’est la révélation majeure de début 2026, et elle remet en cause des mois de données d’outils tiers. J’ai publiée le 6 avril une analyse qui documente un phénomène mesuré à l’échelle mondiale.

Le mécanisme est d’une sophistication inédite. Google ne bloque plus les bots qu’il détecte : il leur sert délibérément des résultats faussés. Quand un crawler est identifié : volume de requêtes élevé, user-agent suspect, absence d’exécution JavaScript, patterns de scraping caractéristiques, le moteur lui retourne des SERPs artificielles appelées Shadow SERPs ou « Soupe Google » :

- YouTube, TikTok, Dailymotion, Instagram et Facebook envahissent les résultats jusqu’en pages 2 et 3, même sur des requêtes 100 % transactionnelles ou textuelles.

- Les vrais résultats organiques (sites web, e-commerces, blogs) sont repoussés, dupliqués ou absents.

- Les outils de tracking ingèrent ces fausses données et les présentent comme une réalité.

Résultat mécanique : quand les plateformes sociales semblent « monter » massivement dans des milliers de requêtes, le Sensor détecte des mouvements de positions gigantesques et affiche 9,5/10. Ce n’est pas un vrai séisme algorithmique. C’est un artefact de mesure.

La confirmation de Monitorank

Fabien, co-fondateur de Monitorank et Semscraper, l’a formulé publiquement sur X le 1er avril 2026 :

“ La forte hausse vient du fait que Google fournit de la soupe avec du YouTube/Dailymotion/TikTok/Instagram aux bots, ce n’est en aucun cas une vraie augmentation de visibilité. ” — Fabien, Monitorank / Semscraper

Monitorank avait documenté le phénomène dès le 3 février 2026 avec une chute brutale de ses courbes, suivie d’un retour massif de vidéos dans les SERPs trackées. L’outil avait déployé un correctif anti-soupe dès février. Google a ensuite renforcé massivement sa détection anti-scraping le 27 mars 2026 date qui correspond précisément, sur le graphique, au début de la dégringolade du Sensor France.

Ce que le Sensor affichait vs. la réalité

| Ce que le Sensor voyait | Ce que voyait un vrai utilisateur |

| TikTok et YouTube en top 3 sur des requêtes transactionnelles | Les vrais sites e-commerce habituels |

| Mouvement massif de centaines de domaines | Stabilité ou légère variation pour les humains |

| Score 9,5/10, « Googlequake » | Volatilité réelle mais bien inférieure |

| Décisions SEO urgentes et réallocations budgétaires | Situation ne nécessitant pas d’action immédiate |

Acte II : Le 0,6/10 : un vrai calme, mais incomplet

Le score plancher actuel n’est pas qu’un simple « retour à la normale ». Il résulte de la superposition de trois phénomènes simultanés :

1. Le renforcement anti-scraping du 27 mars

C’est le déclencheur immédiat visible sur les graphiques. Quand Google a renforcé sa détection le 27 mars, les outils qui recevaient de la « soupe » ont vu leurs données se corriger brutalement. Les plateformes sociales ont disparu des SERPs trackées. Les mouvements artificiels se sont évaporés. Ce qui ressemble à « calme soudain » est en réalité une correction de biais, pas une stabilisation des vraies SERPs.

2. La fin du March 2026 Core Update (8 avril)

Par-dessus cette correction technique, un vrai événement algorithmique s’est terminé. Le March 2026 Core Update (27 mars → 8 avril, 12 jours de déploiement) a achevé son déploiement. Les nouvelles positions se sont figées.

► À retenir : le Sensor mesure des variations journalières, pas des niveaux absolus. C’est un sismographe, pas un altimètre.

3. Un Core Update décrit comme « moins puissant » que prévu

Barry Schwartz (Search Engine Roundtable) a noté que ce Core Update “ ne semblait pas aussi puissant que certains précédents ”, notamment comparé au December 2025 Core Update. La combinaison correction anti-bots + update moins intense + stabilisation post-déploiement = score plancher.

La double illusion ? Le Sensor montre et a montré deux courbes différentes

| Février–mars 2026 : le 9,5/10 | Avril 2026 : le 0,6/10 |

| Volatilité EXTRÊME affichée (en partie fabriquée par les Shadow SERPs) | Calme EXTRÊME affiché (en partie dû à la fin de la soupe + stabilisation post-update) |

| Les vrais SEOs observaient des mouvements réels, mais l’amplitude mesurée était artificiellement amplifiée | Les vrais SEOs observent des positions dégradées que le Sensor ne capte plus |

| Résultat : décisions hâtives, réallocations budgétaires, alertes clients injustifiées | Résultat : fausse impression de stabilité malgré un impact réel du Core Update |

Dans les deux cas, l’outil ne semble pas refléter fidèlement la réalité vécue par les utilisateurs humains. Les deux extrêmes du Sensor sur cette période sont à mon avis peu fiables chacun pour des raisons opposées.

Pourquoi Google fait-il ça ?

Protéger ses données et son monopole

Les bots de tracking mobilisent des ressources serveur considérables. En corrompant les données retournées aux scrapers, Google rend le reverse-engineering de son algorithme exponentiellement plus coûteux.

Rendre le scraping commercial insoutenable

En 2025, Google a supprimé le paramètre &num=100 (multipliant par 10 le nombre de requêtes nécessaires), rendu JavaScript obligatoire pour les vrais résultats, et engagé des poursuites judiciaires via DMCA en décembre 2025 contre SerpApi. Pendant ce temps, Googlebot crawle librement l’intégralité du web pour entraîner Gemini.

Ce que ça change pour votre pratique SEO

Fiabilité des sources : Grille de lecture

| Source | Ce qu’elle mesure | Fiabilité actuelle |

| Google Search Console | Vrais clics / vraies impressions sur votre site | ✅ Très haute mais à confirmer suite à la dernière annonce (dans search console help) expliquant un bug depuis le 13 mai 2025 |

| Google Analytics 4 | Vrai trafic organique | ✅ Haute (mais limité au consentement et adblockers) |

| Semrush Sensor | Volatilité des SERPs crawlées (potentiellement biaisée) | ⚠️ Biaisée |

Les règles à appliquer maintenant

- Retour aux sources first-party. GSC et GA4 restent la meilleure vérité. En cas de divergence avec les outils tiers, toujours faire confiance à la GSC.

- Ne plus lire le Sensor de façon isolée. Un score élevé peut signifier une vraie volatilité, une vague de Shadow SERPs, ou un mix des deux.

- Bien choisir ses outils. Les scrapers qui ont investi dans des correctifs anti-soupe (comme Monitorank) ont une longueur d’avance structurelle.

- Augmenter le monitoring manuel. Tests en conditions réelles, vérifications humaines des SERPs, analyse qualitative.

- Relativiser les alertes. Un 9,5/10 n’est plus automatiquement synonyme de Core Update. Vérifiez avant d’alerter votre client à minuit.

Chronologie des événements clés

| Date | Événement |

| 3 fév. 2026 | Monitorank documente pour la première fois les Shadow SERPs |

| 5 fév. 2026 | Début du February 2026 Discover Core Update (premier Core Update dédié à Discover) |

| Février 2026 | Monitorank déploie un correctif anti-soupe. Sensor monte vers 9,5/10 |

| 27 fév. | Fin du Discover Core Update (22 jours de déploiement) |

| 24-25 mars | March Spam Update : terminé en < 20h, le plus court de l’histoire |

| 27 mars | Début du March 2026 Core Update ET renforcement anti-scraping de Google → chute immédiate du Sensor |

| 1er avr. | Fabien (Monitorank) confirme publiquement la « soupe » sur X |

| 6 avr. | Article d’Eric Garletti décrivant et nommant le phénomène |

| 8 avr. | Fin officielle du March 2026 Core Update (12 jours). Sensor plonge vers 0,6/10 |

| 12 avr. | Sensor France Desktop : 0,6/10 — « It’s too quiet today » |

Ce que tout SEO doit retenir

Nous vivons un moment charnière. Google ne se contente plus de lutter contre le spam dans les résultats : il défend activement ses données contre ceux qui veulent les extraire, et il le fait avec des outils d’une sophistication inédite.

Les données sur lesquelles nous nous appuyions depuis des années sont potentiellement corrompues à la source. Pas toujours, pas partout, pas de façon permanente, mais suffisamment pour qu’une triangulation systématique soit désormais indispensable.

Le Semrush Sensor reste utile. Mais comme tout instrument de mesure, sa valeur dépend de la compréhension de ses limites. En 2026, ces limites sont devenues structurelles : l’outil mesure ce que Google choisit de montrer aux bots et Google choisit de leur montrer des données de plus en plus éloignées de la réalité des utilisateurs humains.

Ce n’est pas une raison de paniquer. Nous devons nous adaptater.