L’Instabilité des SERP en 2026 : Pourquoi Google secoue le SEO et comment y survivre – Décryptage du web épisode 5

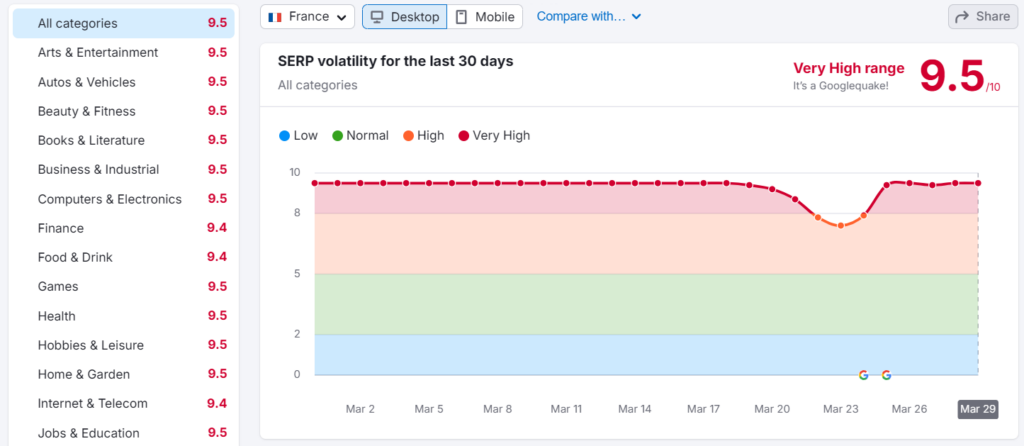

En mars 2026, les tableaux de bord SEO de suivi de position s’affolent. Les positions fluctuent de plusieurs places en quelques heures, les trafics organiques chutent ou explosent sans raison apparente. Le Semrush Sensor flirte avec les 9,5/10, un niveau de « Googlequake » parmi les plus élevés jamais enregistrés. S’agit-il d’une simple turbulence algorithmique ou d’un véritable séisme structural ? La réalité est plus complexe et plus stratégique que jamais.

1. Le Semrush Sensor : votre baromètre quotidien de la volatilité

Le Semrush Sensor analyse chaque jour des millions de mots-clés sur desktop et mobile, dans plus de 20 pays dont la France. Il calcule un score de volatilité sur 10 qui permet de quantifier l’ampleur des remaniements de classement en cours :

- 0–2 : Stabilité (calme plat)

- 2–5 : Volatilité normale

- 5–8 : Volatilité élevée

- 8–10 : Très élevée : « Googlequake »

Depuis janvier 2026, le capteur a frôlé ou atteint 9,5/10 à plusieurs reprises, confirmant une turbulence généralisée et persistante. La volatilité touche tous les secteurs sans exception : e-commerce, actualités, finance, santé, services locaux. Elle ne se limite pas à une niche ou à un type de contenu particulier.

En France, les tendances suivent globalement le mouvement mondial, mais avec des décalages liés aux mises à jour locales et à la personnalisation accrue des résultats selon la localisation et l’historique de navigation.

Le Sensor est disponible sur fr.semrush.com/sensor. Un score élevé signale souvent un remaniement massif des classements. Consultez-le quotidiennement pendant les périodes d’instabilité : c’est votre première ligne d’alerte.

2. Pourquoi une telle instabilité ? Les mises à jour de mars 2026

Google déploie entre 500 et 600 modifications d’algorithme par an. En 2026, la fréquence et l’ampleur s’accélèrent nettement. Trois mises à jour majeures ont structuré le trimestre.

Février 2026 : Discover Core Update

Focalisé sur le flux Discover de Google, ce déploiement a contribué à la volatilité persistante observée dès le début de l’année. Il a reconfiguré la distribution des contenus éditoriaux et d’actualité dans le feed.

24 mars 2026 : Spam Update (terminé en moins de 24h)

Le plus rapide jamais enregistré. Il cible le spam à grande échelle : contenu IA généré en masse sans valeur ajoutée, pages fines (thin content), schémas de liens abusifs et site reputation abuse (parasite SEO).

27 mars 2026 : Core Update (déploiement en cours, ~2 semaines)

Le plus impactant de l’année pour le moment. Il recalibre les signaux de pertinence et d’utilité globale du contenu sur l’ensemble des verticales.

Les trois objectifs stratégiques de Google

Ces mises à jour ne sont pas déconnectées : elles s’inscrivent dans trois ambitions structurantes que Google poursuit avec une cohérence croissante.

1. Améliorer l’expérience utilisateur. Fournir des réponses directes via l’IA, valoriser le contenu utile et ancré dans l’expérience réelle. Les AI Overviews dominent les requêtes informationnelles et peuvent réduire le CTR en position 1 jusqu’à −34 %. Les recherches zero-click deviennent la norme pour beaucoup de questions simples. (Ceci ne concerne pas la France qui est encore un des seul pays au monde à ne pas avoir vu son déploiement).

2. Lutter contre le spam. SpamBrain, le système IA de détection, s’améliore constamment pour sanctionner le contenu IA de faible qualité, les fermes de contenu et les tactiques manipulatrices à grande échelle.

3. Protéger son écosystème. En limitant les données accessibles aux scrapers et outils concurrents, Google réduit la dépendance externe et complique l’entraînement de rivaux comme ChatGPT ou Perplexity. Certains SEO y voient une stratégie anti-scraping pleinement assumée.

3. Une part d’instabilité structurelle : Google cherche encore le bon réglage

Il serait trop simple de voir dans cette volatilité une stratégie entièrement maîtrisée. Une part significative de l’instabilité actuelle reflète probablement quelque chose de plus fondamental : Google n’a pas encore trouvé le bon équilibre entre ses différents objectifs. Intégrer massivement l’IA générative dans les SERP, lutter contre le spam produit par cette même IA, maintenir la pertinence des résultats organiques tout en développant les AI Overviews, protéger les droits des éditeurs partenaires sans les priver de trafic… ces objectifs sont en tension constante les uns avec les autres.

Les mises à jour qui se succèdent à un rythme inhabituel ressemblent moins à un plan huilé qu’à une série d’ajustements successifs, parfois contradictoires. Google teste, mesure, corrige, reteste. Certains signaux remontent trop vite dans les classements, d’autres s’effondrent sans raison apparente, des pans entiers de résultats se réorganisent avant de revenir à leur état précédent quelques jours plus tard. C’est le signe d’un moteur de recherche en pleine transition, qui n’a pas encore stabilisé sa nouvelle doctrine algorithmique à l’ère de l’IA. Pour les professionnels du SEO, cela signifie une chose : les règles du jeu ne sont pas encore écrites, et ceux qui observent attentivement ces tâtonnements ont une longueur d’avance sur ceux qui attendent que la poussière retombe.

4. Les Shadow SERP : Google piège-t-il délibérément les robots des outils ?

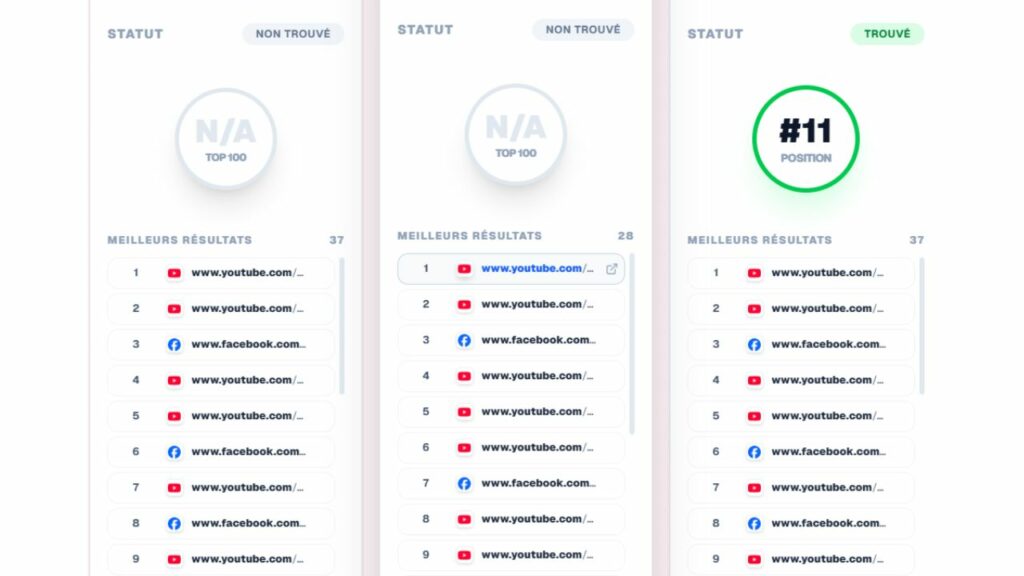

C’est le sujet le plus brûlant et le plus polémique du moment. Depuis plusieurs mois, des indices convergents suggèrent que Google adapte volontairement les SERP visibles par les robots des outils de suivi de positionnement (Semrush, Ahrefs, Monitorank, Semscraper, etc.).

Lorsqu’un comportement automatisé est identifié (volume de requêtes élevé, user-agent suspect, absence de JavaScript, pattern de scraping reconnu), Google sert des résultats dégradés ou biaisés : par exemple, une sur-représentation de vidéos YouTube ou Dailymotion, même sur des requêtes où elles ne devraient pas dominer.

La chronologie des événements

- Depuis plusieurs mois : des SERP dégradées sont servies aux bots détectés, avec une sur-représentation anormale de vidéos YouTube et Dailymotion, même sur des requêtes où celles-ci ne devraient pas figurer.

- Février 2026 : Monitorank déploie un correctif technique pour contourner la détection et retrouver des données fiables.

- 27 mars 2026 : Google renforce sa détection. Retour des SERP biaisées pour les bots repérés. Monitorank affirme que son correctif reste efficace ; Semscraper confirme être également sous contrôle.

- Conséquence directe : les positions affichées par les outils sont de plus en plus décorrélées de la réalité vue par un utilisateur humain.

« Google qui piège les scrapers pendant que Googlebot crawle tout pour son IA, c’est culotté. »

SEO, communauté X/Twitter, mars 2026

Chez « Monitorank » le problème semble résolu

Pourquoi c’est problématique

Si votre outil de tracking reçoit des SERP biaisées, vos rapports de positionnement sont incorrects. Vous risquez de prendre des décisions SEO fondées sur une réalité qui n’existe pas : arbitrages budgétaires, reporting client, priorités d’optimisation. Les éditeurs qui ne le savent pas perdent un temps considérable à investiguer des problèmes qui n’existent pas côté utilisateurs réels.

Le double standard qui fait débat

Google exige que les sites respectent les robots.txt et les CGU, et poursuit en justice les scrapers commerciaux (procès SerpAPI, décembre 2025). Parallèlement, Googlebot crawle librement l’intégralité du web pour entraîner Gemini. Cette asymétrie nourrit un débat éthique intense dans la communauté SEO et juridique. Comme le résume un SEO connu : Google construit son empire en scrapant le web, puis utilise la loi pour empêcher les autres de faire de même.

5. Conséquences concrètes pour éditeurs, e-commerces et agences

L’instabilité n’est pas abstraite. Elle se traduit en impacts mesurables et souvent brutaux pour tous les acteurs du digital.

- Éditeurs / blogs : chutes de trafic de −30 % à −80 % sur les requêtes informationnelles cannibalisées par les AI Overviews. Le contenu de type « réponse à une question » est le plus exposé.

- E-commerce : les requêtes transactionnelles résistent mieux aux AI Overviews, mais la concurrence des résultats sponsorisés et Shopping s’intensifie. Les signaux d’engagement (temps sur page, interactions, retours) pèsent de plus en plus lourd.

- Agences SEO : données outils moins fiables à cause des shadow SERP, reporting client complexifié, investissement croissant en monitoring humain et tests manuels.

- Sites spam / IA low-value : sanctions sévères du Spam Update. Déindexations brutales et immédiates. Le risque est désormais quasi-certain pour ces pratiques.

- Contenus E-E-A-T forts : gains de positions sur requêtes concurrentielles. Résilience accrue face aux updates. C’est ici que se trouvent les opportunités.

Le problème des données de mesure

Entre les shadow SERP, la suppression du paramètre num=100 (forçant les scrapers à multiplier les requêtes par 10), et le renforcement de JavaScript obligatoire, les outils de suivi perdent progressivement en précision. Il ne s’agit pas d’un bug : c’est une politique délibérée de Google visant à augmenter le coût et la complexité du scraping commercial.

Bonne pratique immédiate : Croisez systématiquement vos données d’outils tiers avec Google Search Console (données first-party, non biaisées) et votre Analytics (trafic réel utilisateurs). En cas de divergence importante, la GSC prime toujours.

6. Les autres sujets qui font débat en mars 2026

La fin du modèle « position = trafic »

C’est une transformation fondamentale. Être en position 1 ne garantit plus un volume de trafic prévisible. Avec les AI Overviews et les widgets enrichis (Knowledge Panels, Featured Snippets, Carousels), une part croissante des requêtes informationnelles obtient une réponse directe dans la SERP, sans générer de clic. Le modèle rang → trafic → revenus doit être profondément repensé. Le trafic organique informationnel ne reviendra pas à ses niveaux d’avant sans un repositionnement stratégique.

La chasse au contenu IA de masse

Attention à la nuance : le problème ciblé par le Spam Update n’est pas l’IA elle-même, mais son utilisation pour produire du contenu thin ou dupliqué à grande échelle, sans valeur ajoutée. Un contenu généré partiellement avec l’IA, bien structuré, ancré dans une expérience réelle et validé par un expert humain identifié, reste parfaitement valide pour Google. C’est l’usage industriel et sans discernement qui est sanctionné.

L’hyper-exigence E-E-A-T

Google renforce progressivement la valorisation des quatre signaux E-E-A-T :

- Experience (Expérience) : l’auteur a-t-il une expérience vécue du sujet ? Les témoignages, tests et cas concrets sont de plus en plus valorisés.

- Expertise : maîtrise technique ou thématique démontrée. L’auteur doit être identifié, avec des credentials visibles (biographie, page auteur, réseaux professionnels).

- Authoritativeness (Autorité) : notoriété et reconnaissance dans le domaine. Backlinks de qualité, mentions tierces, présence éditoriale.

- Trustworthiness (Fiabilité) : exactitude factuelle, transparence éditoriale, sources citées, page À propos complète, politique de confidentialité à jour.

AI-Generated Titles et expérimentations SERP

Google expérimente activement la réécriture des balises titre via l’IA dans les résultats de recherche. Cela peut modifier significativement la façon dont vos pages apparaissent, et donc leur taux de clic, sans que vous en soyez informé. Vérifiez régulièrement en navigation réelle comment vos titres s’affichent réellement dans les SERP.

La divergence info vs transactionnel

Deux mondes coexistent dans les SERP de 2026. Les requêtes informationnelles sont envahies par l’IA et génèrent de moins en moins de clics vers les sites. Les requêtes transactionnelles restent plus classiques mais sont ultra-concurrentielles, avec une pression croissante des annonces Shopping et des résultats locaux. La stratégie SEO doit désormais se construire en tenant compte de ce clivage structurel.

7. Stratégies de survie (et d’opportunité) en 2026

L’instabilité n’est plus une anomalie conjoncturelle : elle est la nouvelle normalité du SEO. La question n’est plus « quand ça va se stabiliser » mais « comment opérer efficacement dans un environnement en mutation permanente ».

1. Surveiller en continu

Semrush Sensor + Google Search Console + Analytics en priorité. Configurez des alertes automatiques pour les variations significatives de trafic et de positionnement. Ne découvrez pas un problème trois semaines après qu’il s’est produit.

2. Prioriser la valeur réelle

Contenu utile, structuré, ancré dans l’expérience humaine, avec des auteurs transparents et identifiés. Optimisez pour les AI Overviews en proposant des réponses claires et directes, des listes, des tableaux comparatifs et des définitions précises en début d’article.

3. Diversifier les sources de trafic

Newsletter, réseaux sociaux, trafic direct, paid search, YouTube, podcasts, partenariats éditoriaux. Ne plus dépendre à 80 %+ du trafic organique Google. Cette dépendance était déjà un risque avant 2026 ; elle est aujourd’hui un danger existentiel pour de nombreux éditeurs.

4. Tester manuellement et régulièrement

Vérifiez les SERP en navigation réelle : mode incognito, VPN sur différentes localisations, desktop et mobile. Ne faites pas confiance aveuglément aux seuls outils tiers pendant les périodes de shadow SERP : les données peuvent être significativement faussées.

5. Être agile au lendemain d’un update

Auditez rapidement après chaque déploiement majeur : vérifiez les signaux E-E-A-T, identifiez le thin content, analysez le profil de liens. Les premières 72h après un update sont les plus informatives pour comprendre ce qui a bougé et pourquoi.

6. Éviter les pratiques à risque

Fuyez le contenu IA low-value à grande échelle, les schémas de liens artificiels et le parasite SEO. Le Spam Update de mars 2026 prouve que Google peut sanctionner vite, fort et sans avertissement. Le rapport risque/bénéfice de ces pratiques est désormais clairement négatif.

La règle d’or de 2026 : Créez du contenu qui serait utile et légitime même si Google n’existait pas. La qualité intrinsèque est la seule protection durable contre l’instabilité algorithmique. Les tactiques d’optimisation pure sont de plus en plus éphémères ; la valeur réelle pour l’utilisateur est pérenne.

Le SEO entre dans une nouvelle ère ?

Mars 2026 marque un point d’inflexion. Google ne se contente plus d’ajuster son algorithme : il remodèle activement l’économie de l’information en ligne. Shadow SERP, AI Overviews cannibalisantes, Spam Updates ultra-rapides, suppression de paramètres historiques… chaque décision s’inscrit dans une stratégie cohérente visant à contrôler la distribution de la valeur sur le web.

Ceux qui s’accrochent aux vieilles recettes SEO (volumes de contenu IA, manipulation de liens, dépendance à un seul canal) perdront du terrain. Ceux qui misent sur la qualité authentique, l’expérience utilisateur exceptionnelle et une approche multi-canal sortiront renforcés de cette période de turbulences.

L’instabilité n’est pas votre ennemie si vous la comprenez. Elle est une fenêtre d’opportunité pour ceux qui savent lire les signaux et s’adapter vite.

Vous avez été impacté par le Spam Update ou le Core Update de mars ? Avez-vous remarqué des biais dans vos outils de tracking ? Partagez vos observations en commentaire : la communauté SEO a plus que jamais besoin d’échanges concrets.